Das Verbinden eines ESX(i) 4 Servers mit dem iSCSI SAN ist recht einfach über den vSphere Client machbar.

Netzwerkadapter einrichten

Im vSphere Client wechselt man zuerst auf den Reiter „Configuration“ und wählt dann in der Rubrik Hardware „Networking“ aus. Im rechten Teil des Fensters ist nun „Add Networking“ zu wählen.

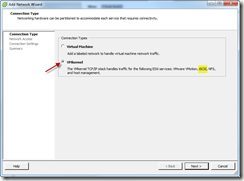

Im nächsten Dialog wählt man als Verbindungstyp „VMkernel“.

Als nächstes steht die Auswahl der Netzwerkkarte für das SAN aus. Es ist zu empfehlen mindestens eine dedizierte NIC dafür bereit zu stellen.

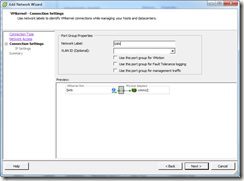

Nun kann man noch den Namen für das virtuelle Switch vergeben – alle anderen Optionen sollte man hier nicht auswählen.

Selbstverständlich braucht der Adapter auch eine IP – diese gibt man in der folgenden Maske zusammen mit der Subnet Mak ein.

… kurz die Zusammenfassung prüfen und das neue Netzwerk mit einem Klick auf „Finish“ anlegen. Das ganze sollte danach so aussehen:

Storage Adapter einrichten

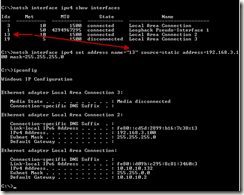

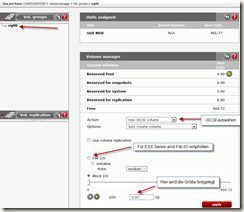

Um den Storage Adapter (iSCSI Software Adapter) einzurichten wechseln wir zu dem Menüpunkt „Storage Adapters“ und wählen dort den iSCSI Software Adapter aus.

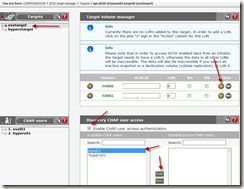

In dem sich öffnenden Fenster sollten zuerst die CHAP Credentials Hinterlegt werden.

Nun wechseln wir auf den Reiter „Dynamic Discovery“ und fügen über den „Add“ Button unseren iSCSI Host Server hinzu (IP des open-e Servers an der verbundenen NIC).

Nach einem Klick auf „close“ will der ESX einen rescan des host bus adapters (HBA) durchführen. Dies lassen wir ihn selbstverständlich tun.

Sollte die Liste der gefunden Devices wie bei mir leer sein, so hat der Dynamic Discovery Prozess nicht funktioniert.

Wie das passieren kann weiß ich leider nicht, aber das Umschiffen des Problems ist recht simpel. Man geht dazu erneut in die Properties des iSCSI Software Adapters und wählt dort den Reiter „Static Discovery“. Über einen weiteren Klick auf „Add“ kann man seine Targets von Hand hinzufügen.

Nachdem dieser Schritt für alle Targets erledigt wurde, sollten diese in der Liste zu sehen sein:

Datastore Anlegen

Zum Schluss müssen die soeben verbundenen LUNs noch als Datastores eingebunden werden. Hierzu wählt man im Menü den Punkt „Storage“ und danach „Add Storage“.

Die nächste Auswahl ist dann natürlich „Disk/LUN“.

Gefolgt von der Auswahl des gewünschten LUNs

Der ESX analysiert nun das neue LUN und stellt fest, dass dieses derzeit leer ist.

Im nächsten Schritt darf man seinem Datastore einen Namen verpassen.

Den Vorschlag zum block size auf der folgenden Seite sollte man in aller Regel übernehmen (es sei denn man weiß sehr genau was man da tut…)

Jetzt sind wir nur noch eine Zusammenfassung von unserem neuen Datastore entfernt.

[Update]

iSCSI SAN für ESXi & Hyper-V – Teil 1

iSCSI SAN für ESXi & Hyper-V auf Basis von open-e – Teil 2

iSCSI SAN für ESXi & Hyper-V auf Basis von open-e – Teil 3

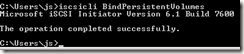

iSCSI SAN für Hyper-V (Win2k8R2 core) auf Basis von open-e – Teil 4

iSCSI SAN für ESXi auf Basis von open-e – Teil 5

Multipath I/O (MPIO) mit Windows 2008 R2 Server Core und iSCSI